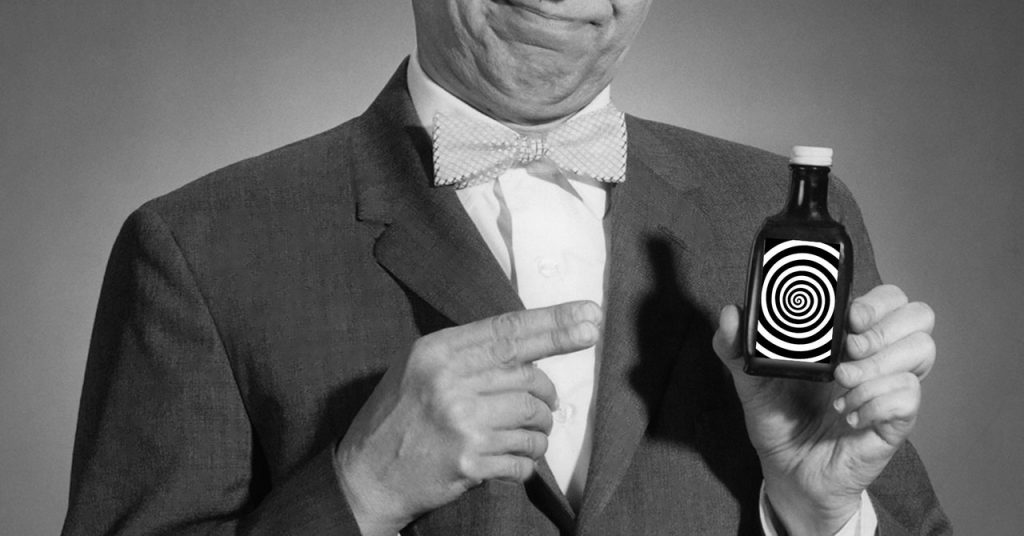

أرفيند نارايانان، أ أستاذ علوم الكمبيوتر في جامعة برينستون، معروف بفضحه للضجة المحيطة بالذكاء الاصطناعي في كتابه Substack، زيت الثعبان AIكتب هذا الكتاب بالتعاون مع المرشحة لنيل درجة الدكتوراه ساياش كابور. وقد أصدر المؤلفان مؤخرًا كتابًا يعتمد على نشرتهما الإخبارية الشهيرة حول أوجه القصور في الذكاء الاصطناعي.

ولكن لا تخلط الأمور، فهم لا يعارضون استخدام التكنولوجيا الجديدة. يقول نارايانان: “من السهل تفسير رسالتنا بشكل خاطئ على أنها تقول إن الذكاء الاصطناعي ضار أو مشكوك فيه”. ويوضح خلال محادثة مع WIRED أن توبيخه لا يستهدف البرمجيات في حد ذاتها، بل الجناة الذين يواصلون نشر ادعاءات مضللة حول الذكاء الاصطناعي.

في زيت الثعبان AIإن المسؤولين عن إدامة دورة الضجيج الحالية ينقسمون إلى ثلاث مجموعات أساسية: الشركات التي تبيع الذكاء الاصطناعي، والباحثون الذين يدرسون الذكاء الاصطناعي، والصحفيون الذين يغطون موضوع الذكاء الاصطناعي.

مُنشرو الضجيج الفائقون

إن الشركات التي تدعي أنها قادرة على التنبؤ بالمستقبل باستخدام الخوارزميات تُعَد من أكثر الشركات احتيالاً. ويكتب نارايانان وكابور في الكتاب: “عندما يتم نشر أنظمة الذكاء الاصطناعي التنبؤية، فإن أول الأشخاص الذين تلحق بهم الأذى هم في الغالب الأقليات وأولئك الذين يعيشون بالفعل في فقر”. على سبيل المثال، استهدفت خوارزمية استخدمتها حكومة محلية في هولندا من قبل للتنبؤ بمن قد يرتكب احتيالاً على الرعاية الاجتماعية النساء والمهاجرين الذين لا يتحدثون الهولندية.

وينظر المؤلفون بعين الشك أيضًا إلى الشركات التي تركز بشكل أساسي على المخاطر الوجودية، مثل الذكاء الاصطناعي العام، ومفهوم الخوارزمية الفائقة القوة التي تتفوق على البشر في أداء العمل. ومع ذلك، فإنهم لا يسخرون من فكرة الذكاء الاصطناعي العام. يقول نارايانان: “عندما قررت أن أصبح عالم كمبيوتر، كانت القدرة على المساهمة في الذكاء الاصطناعي العام جزءًا كبيرًا من هويتي وحافزي”. يأتي عدم التوافق من إعطاء الشركات الأولوية لعوامل الخطر طويلة الأجل فوق التأثير الذي تخلفه أدوات الذكاء الاصطناعي على الناس في الوقت الحالي، وهي عبارة شائعة سمعتها من الباحثين.

ويزعم المؤلفون أن الكثير من المبالغة وسوء الفهم يمكن أن يُعزى أيضًا إلى أبحاث رديئة وغير قابلة للتكرار. يقول كابور: “لقد وجدنا أنه في عدد كبير من المجالات، تؤدي قضية تسرب البيانات إلى ادعاءات مفرطة في التفاؤل حول مدى نجاح الذكاء الاصطناعي”. يحدث تسرب البيانات بشكل أساسي عندما يتم اختبار الذكاء الاصطناعي باستخدام جزء من بيانات تدريب النموذج – على غرار توزيع الإجابات على الطلاب قبل إجراء الاختبار.

في حين يتم تصوير الأكاديميين في زيت الثعبان AI وبحسب باحثي جامعة برينستون، فإن الصحفيين الذين يرتكبون “أخطاء الكتب المدرسية” لديهم دوافع خبيثة ويرتكبون الخطأ عن علم: “العديد من المقالات هي مجرد بيانات صحفية أعيد صياغتها وتم غسلها على أنها أخبار”. ويُشار إلى المراسلين الذين يتجنبون التغطية الصادقة لصالح الحفاظ على علاقاتهم مع شركات التكنولوجيا الكبرى وحماية وصولهم إلى المديرين التنفيذيين للشركات على أنهم سامون بشكل خاص.

أعتقد أن الانتقادات الموجهة إلى صحافة الوصول عادلة. وفي نظرة إلى الوراء، كان بوسعي أن أطرح أسئلة أكثر صعوبة أو أكثر ذكاءً خلال بعض المقابلات مع أصحاب المصلحة في أهم الشركات في مجال الذكاء الاصطناعي. ولكن ربما كان المؤلفون يبالغون في تبسيط الأمر هنا. وحقيقة أن شركات الذكاء الاصطناعي الكبرى سمحت لي بالدخول لا تمنعني من كتابة مقالات متشككة حول تكنولوجيتها، أو العمل على مقالات استقصائية أعلم أنها ستغضبهم. (نعم، حتى لو أبرموا صفقات تجارية، كما فعلت شركة OpenAI، مع الشركة الأم لـ WIRED).

وقد تكون القصص الإخبارية المثيرة مضللة بشأن القدرات الحقيقية للذكاء الاصطناعي. ويسلط نارايانان وكابور الضوء على نص المحادثة الآلية لعام 2023 الذي كتبه كاتب عمود نيويورك تايمز كيفن روز والذي تفاعل مع أداة مايكروسوفت بعنوان “دردشة الذكاء الاصطناعي لـ Bing: “أريد أن أكون على قيد الحياة. 😈” كمثال على الصحفيين الذين يزرعون الارتباك العام حول الخوارزميات الواعية. يقول كابور: “كان روز أحد الأشخاص الذين كتبوا هذه المقالات. لكنني أعتقد أنه عندما ترى عنوانًا تلو الآخر يتحدث عن رغبة روبوتات الدردشة في العودة إلى الحياة، فقد يكون لذلك تأثير كبير على نفسية الجمهور”. يذكر كابور روبوت الدردشة ELIZA من ستينيات القرن العشرين، والذي قام مستخدموه بسرعة بتشبيه أداة ذكاء اصطناعي بدائية، كمثال رئيسي على الرغبة الدائمة في إسقاط الصفات البشرية على مجرد خوارزميات.